青島長城保潔 專業(yè)構筑潔凈空間,全方位守護建筑之美

在美麗的海濱城市青島,建筑物的整潔與光鮮是城市風貌的重要組成部分。無論是高聳入云的寫字樓、溫馨舒適的住宅小區(qū),還是人流如織的商業(yè)中心,其清潔維護都離不開專業(yè)、可靠的服務。青島長城保潔,正是這樣一家致力于提供全方位、高標準建筑物清潔服務的專業(yè)機構,以其全面的服務項目、嚴謹?shù)墓ぷ鲬B(tài)度和先進的清潔技術,成為眾多企業(yè)與家庭信賴的潔凈伙伴。

專業(yè)工程保潔,為項目交付奠定堅實基礎

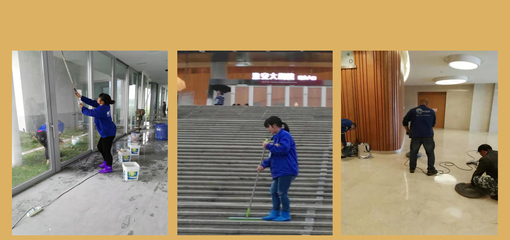

工程保潔,又稱開荒保潔,是建筑物投入使用前或裝修后的首次深度清潔。這絕非簡單的打掃,而是一項系統(tǒng)、復雜且要求極高的專業(yè)工作。青島長城保潔的工程保潔團隊,針對新建樓盤、寫字樓、商場、工廠等各類物業(yè),制定詳盡的清潔方案。他們使用專業(yè)的工業(yè)吸塵器、高壓水槍、多功能洗地機等設備,并搭配不同性質(zhì)的清潔劑,有效清除裝修后殘留的水泥漬、油漆點、膠痕、粉塵以及各種頑固污垢。從天花板、墻面到地面,從管道井到設備間,每一個角落都經(jīng)過徹底清理,確保交付給客戶的是一個窗明幾凈、一塵不染的嶄新空間,為后續(xù)的日常使用或經(jīng)營創(chuàng)造最佳起點。

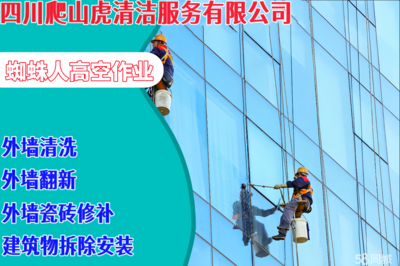

高空外墻清洗,讓建筑煥發(fā)“面子”光彩

建筑的外墻是其“臉面”,長期暴露在風雨、沙塵和空氣中污染物的侵蝕下,極易積聚污垢,不僅影響美觀,也可能加速外墻材料的老化。青島長城保潔擁有專業(yè)的高空作業(yè)資質(zhì)和經(jīng)驗豐富的“蜘蛛人”團隊。他們采用高空吊板、吊籃或升降機等專業(yè)設備,嚴格遵守高空作業(yè)安全規(guī)范,使用環(huán)保安全的中性清潔劑和高壓水槍,針對玻璃幕墻、鋁塑板、瓷磚、石材等不同材質(zhì)的外墻,進行安全、高效的清洗。經(jīng)過專業(yè)清洗后的建筑外墻,能夠有效去除污漬、水痕和銹斑,恢復其原有色澤與光潔度,顯著提升建筑的整體形象與價值。

精細擦玻璃服務,透亮視野盡收眼底

玻璃的通透性是現(xiàn)代建筑設計的靈魂。無論是辦公樓巨大的落地窗,還是住宅陽臺的玻璃護欄,保持其潔凈透亮至關重要。青島長城保潔的擦玻璃服務,針對不同高度和環(huán)境的玻璃,采用不同的清潔工藝。對于高層玻璃,同樣由專業(yè)高空作業(yè)人員完成;對于室內(nèi)或低層玻璃,則使用專用玻璃刮、涂水器、無絨毛巾等工具,配合高效去污的玻璃清潔劑,徹底清除玻璃表面的指紋、水漬、油污和灰塵。服務完成后,玻璃光潔如新,室內(nèi)采光得到極大改善,窗外的風景也更加清晰動人。

深度洗地毯服務,呵護地面健康與美觀

地毯廣泛應用于辦公室、酒店、會所及家庭中,它能吸附灰塵、細菌和過敏原,定期深度清潔必不可少。青島長城保潔提供專業(yè)的洗地毯服務,使用大功率多功能地毯清洗機。該設備通過噴水、刷洗、吸污同步完成的原理,能夠?qū)⑸畈卦诘靥豪w維深處的泥沙、污漬、細菌及螨蟲有效萃取出來,清潔效果遠勝于普通吸塵。根據(jù)地毯的材質(zhì)和污染程度,選用合適的清潔劑,在強力去污的同時保護地毯纖維,延長其使用壽命。清洗后的地毯不僅色澤鮮艷、蓬松柔軟,更能顯著改善室內(nèi)空氣質(zhì)量,營造更健康、舒適的環(huán)境。

綜合建筑清潔,定制化的日常維護方案

除了上述專項服務,青島長城保潔還提供全面的日常建筑物清潔維護服務。他們可以根據(jù)客戶的需求,定制長期或定期的保潔計劃,內(nèi)容包括但不限于:公共區(qū)域的地面清潔與保養(yǎng)、衛(wèi)生間深度清潔與消毒、垃圾收集與清運、各種裝飾表面(如不銹鋼、銅器)的保養(yǎng)等。公司注重員工培訓,確保每一位保潔員都掌握規(guī)范的清潔流程與標準,使用環(huán)保的清潔物料,在維持環(huán)境整潔的也踐行著綠色保潔的理念。

青島長城保潔秉承“專業(yè)、高效、安全、誠信”的服務宗旨,將清潔工作從簡單的體力勞動提升為專業(yè)的空間維護科學。從宏大的工程開荒到精細的玻璃擦拭,從高空外墻的煥新到室內(nèi)地毯的深層呵護,他們用專業(yè)的技能和負責任的態(tài)度,守護著青島每一處建筑的潔凈與美麗。選擇青島長城保潔,即是選擇一份對品質(zhì)生活的承諾,也是對工作與居住環(huán)境的一份貼心投資。

如若轉(zhuǎn)載,請注明出處:http://www.sybcj.cn/product/37.html

更新時間:2026-04-06 08:35:48